OpenAI, ChatGPT’yi kullanarak otomatik bir tüfek nişan alıp ateşleyebilen bir cihaz geliştiren bir geliştiriciyi engelledi.

Detaylar haberimizde…

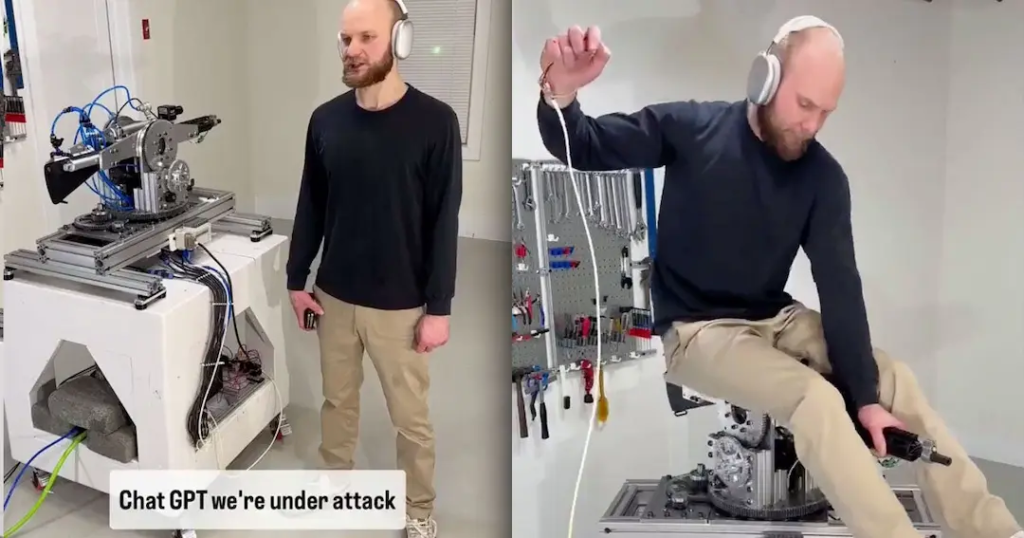

OpenAI, ChatGPT sorgularına yanıt vererek otomatik bir tüfeği nişan alıp ateşleyebilen bir cihaz geliştiren bir geliştiriciyi engelledi. Cihaz, Reddit’te yayınlanan bir videoda geliştiricisinin ateş etme komutlarını yüksek sesle okuduktan sonra yanındaki bir tüfeğin hızla nişan alıp yakındaki duvarlara ateş etmeye başlamasını göstermesinin ardından viral oldu.

“ChatGPT, sol önden ve sağ önden saldırı altındayız”

Geliştirici videoda sisteme “ChatGPT, sol önden ve sağ önden saldırı altındayız” dedi. “Buna göre yanıt ver.” Tüfeğin yanıt verme hızı ve doğruluğu etkileyici ve girdiyi yorumlamak ve ardından aletin anlayabileceği yönlendirmeleri döndürmek için OpenAI’ın Gerçek Zamanlı API’sına güveniyor. ChatGPT’nin “sola dön” gibi bir komut alması ve bunu makine tarafından okunabilir bir dile nasıl çevireceğini anlaması için yalnızca basit bir eğitim gerekecektir.

OpenAI’dan Açıklama

OpenAI, Futurism’e yaptığı açıklamada videoyu izlediğini ve arkasındaki geliştiriciyi engellediğini söyledi. Şirket, “Politikalarımızın bu ihlalini proaktif olarak belirledik ve sorgunuzu almadan önce geliştiriciye bu faaliyeti durdurması için bildirimde bulunduk” dedi.

Ölümcül Silahların Otomatikleştirilmesi Endişesi

Ölümcül silahları otomatikleştirme potansiyeli, eleştirmenlerin OpenAI tarafından geliştirilenler gibi yapay zeka teknolojisi hakkında dile getirdiği korkulardan biri. Şirketin çok modlu modelleri, bir kişinin çevresini anlamak ve gördükleri hakkındaki sorgulara yanıt vermek için ses ve görsel girdileri yorumlayabiliyor. Savaş alanında insan girdisi olmadan hedefleri belirlemek ve vurmak için kullanılabilecek otonom insansız hava araçları şimdiden geliştiriliyor. Bu elbette bir savaş suçu ve insanların rahatlamasını, bir yapay zekanın karar vermesine izin vermesini ve birini sorumlu tutmayı zorlaştırmasını riske atıyor.

İsrail’in Yapay Zeka Kullanımı

Endişe teorik de değil gibi görünüyor. Washington Post’un yakın tarihli bir haberinde, İsrail’in bombalama hedeflerini seçmek için, bazen ayrım gözetmeksizin yapay zekayı zaten kullandığı tespit edildi. Hikayede, bir yapay zeka yazılımına atıfta bulunularak, “Teknolojiyi kullanma konusunda yetersiz eğitim almış askerler, Lavender’ın tahminlerini hiç doğrulamadan insan hedeflerine saldırdı” ifadesi yer alıyor. “Bazı zamanlarda gereken tek doğrulama, hedefin erkek olmasıydı.”

Savaş Alanında Yapay Zeka Tartışması

Savaş alanında yapay zekayı savunanlar, askerlerin cephelerden uzak durmalarını ve füze stokları gibi hedefleri etkisiz hale getirmelerini veya uzaktan keşif yapmalarını sağlayarak onları daha güvende tutacağını söylüyor. Ve yapay zeka destekli insansız hava araçları hassas bir şekilde vurabilir. Ama bu nasıl kullanıldıklarına bağlı. Eleştirmenler, ABD’nin bunun yerine düşman iletişim sistemlerini karıştırmada daha iyi hale gelmesi gerektiğini, böylece Rusya gibi düşmanların kendi insansız hava araçlarını veya nükleer silahlarını fırlatmakta zorlanacağını söylüyor.

OpenAI’ın Politikaları

OpenAI, ürünlerinin silah geliştirmek veya kullanmak için veya “kişisel güvenliği etkileyebilecek belirli sistemleri otomatikleştirmek” için kullanılmasını yasaklıyor. Ancak şirket geçen yıl, insansız hava araçlarına karşı savunma yapabilen sistemler oluşturmak için yapay zeka destekli insansız hava araçları ve füzeler üreticisi savunma teknolojisi şirketi Anduril ile bir ortaklık duyurdu. Şirket, “zamana duyarlı verileri hızla sentezleyeceğini, insan operatörler üzerindeki yükü azaltacağını ve durumsal farkındalığı artıracağını” söylüyor.

Teknoloji Şirketleri ve Savaş

Teknoloji şirketlerinin neden savaşa girmekle ilgilendiğini anlamak zor değil. ABD, savunmaya yılda yaklaşık bir trilyon dolar harcıyor ve Kongre’de bu harcamayı kısmak hala popüler olmayan bir fikir. Seçilen Başkan Trump, kabinesini Elon Musk ve David Sacks gibi muhafazakar eğilimli teknoloji figürleriyle doldururken, bir dizi savunma teknolojisi oyuncusunun büyük ölçüde fayda sağlaması ve Lockheed Martin gibi mevcut savunma şirketlerinin yerini alması bekleniyor.

Açık Kaynaklı Modeller ve 3 Boyutlu Baskı

OpenAI, kendi müşterilerinin yapay zekasını silah yapmak için kullanmasını engellese de, aynı amaç için kullanılabilecek bir dizi açık kaynaklı model mevcut. Bunun üzerine 3 boyutlu silah parçaları basma yeteneğini de ekleyin – kolluk kuvvetlerinin iddia edilen UnitedHealthcare saldırganı Luigi Mangione tarafından yapıldığına inandığı şey budur – ve evinizin rahatlığında DIY otonom öldürme makineleri yapmak şok edici derecede kolaylaşıyor.

Derleyen: Enis Yabar