Güçlü yapay zekâ görüntü oluşturucularının geçtiğimiz yılki yükselişinden beri sanatçılar, özellikle de çalışmaları önceden izin alınmadan modelleri eğitmek için kullanılanlar, geçim kaynaklarına yönelik hızla gelişmekte olan tehdit hakkında konuşuyorlar. Son zamanlarda sanatçıların hayal kırıklıkları bir toplu davaya bile dönüştü.

DALL-E, Midjourney ve Stable Diffusion gibi büyük platformların bir sanatçının tarzını ne kadar kolay bir şekilde taklit edebildiğini görmek için sanatçının adını komut istemine yazmanız yeterli.

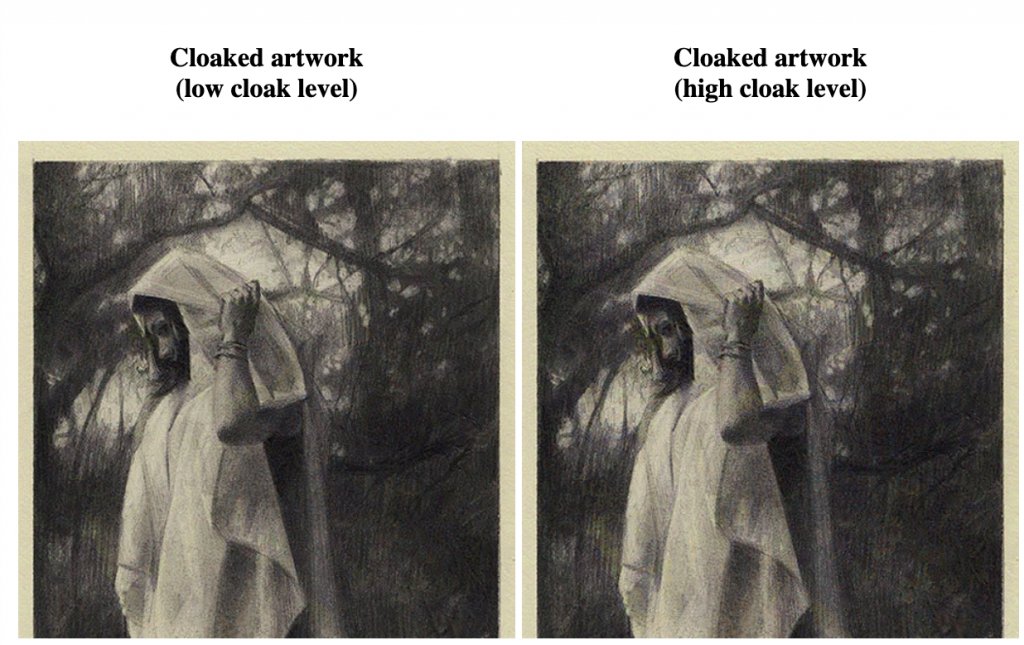

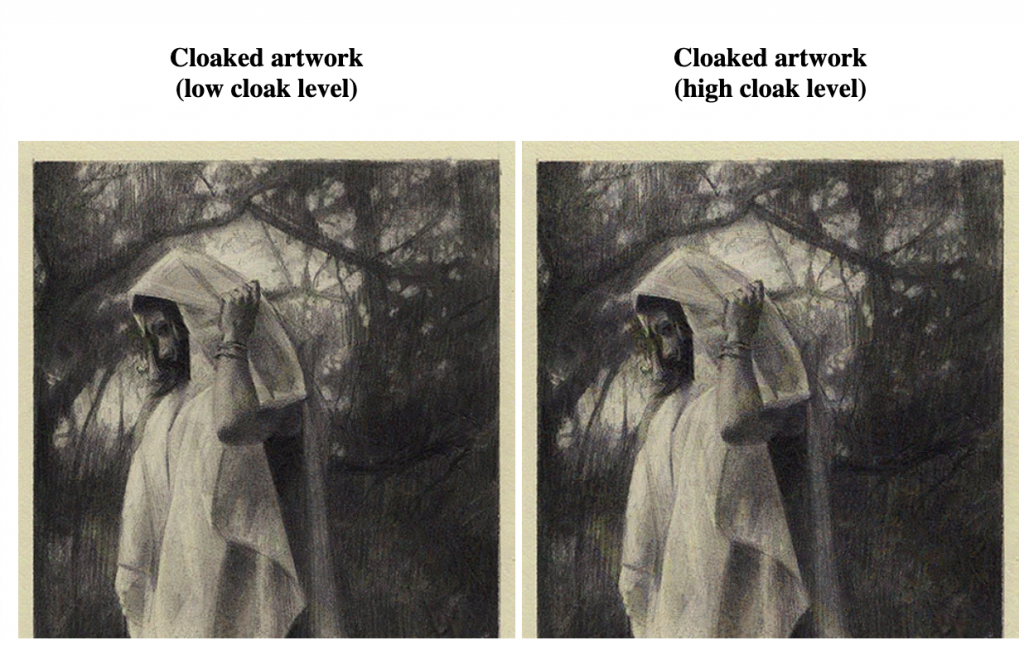

Şimdi ise araştırmacılar, sanatçıları bu tür intihallerden korumayı amaçlayan yeni bir araç geliştirdiler. “Glaze” adı verilen bu teknoloji görüntüleri “gizleyerek” çalışıyor; fırça darbesi, palet, doku ya da gölge kullanımı gibi stilin belirleyici özelliklerine ince değişiklikler getiriyor. Ancak bu farklılıklar çıplak insan gözü için asgari düzeyde kalıyor.

“Glaze”, Chicago Üniversitesinde, üniversitenin araştırma grubu SAND Lab ile bağlantılı bilgisayar bilimcilerinden oluşan bir ekip tarafından geliştirildi. Projenin temel fikri ise 2020 yılında SAND Lab tarafından geliştirilen ve kişisel fotoğrafları yüz tanıma modelleri için veri olarak kullanılamayacak şekilde “gizleyen” bir algoritma olan Fawkes’tan esinlenerek geliştirildi. Glaze, sanatçıların laboratuvara ulaşarak yardım talep etmelerinin ardından, laboratuvarın sorunun boyutunu değerlendirmek üzere 1.000’den fazla sanatçıyla yaptığı anket sonucunda ortaya çıktı.

Çalışmanın yazarlarından yüksek lisans öğrencisi Shawn Shan, Fawkes konseptini sanat eserlerine uyarlamak için, “temelde stilistik özellikleri görüntüden nesneden ayırdığınız ve yalnızca stil özelliğini bozmaya çalıştığınız bir yol tasarlamamız gerekiyordu” dedi.

Yapılan çalışmalar sonucunda araştırmacılar, “stil transferi” olarak bilinen yakın ilişkili bir yapay zekâ formunu yapay zekâ görüntü oluşturucularına karşı kullanabileceklerini fark ettiler.

“Stil transferi” modelleri, mevcut bir görüntüyü içeriği değiştirmeden farklı bir stilde yeniden yaratır. Bu nedenle Glaze, bir eserin stilini değiştirmek için hangi özelliklerin değiştirilmesi gerektiğini belirleyen bir algoritma kullanır. Ardından üretici modelleri karıştırarak, bu özellikleri gereken minimum miktarda “bozar”.

Araştırmayı yürüten profesörlerden Ben Zhao, “Bu bilgiyi modele saldırmak için kullanıyor ve görüntü oluşturucu modeli, eserde kullanılandan farklı bir tarzı algılaması için yanlış yönlendiriyoruz” diye açıkladı.

Yaklaşımın verimliliği, üretken bir modelin gizlenmiş görüntülerle eğitilmesi ve ardından aynı sanatçının tarzında eser üretmesi istenerek test edildi. Araştırmacılara göre bu görüntüler, girdi görüntüleri gizlenmediğinde ortaya konan eserlerden daha başarısız taklitler oldu. Bu sonuçlar sanatçılardan oluşan bir grup tarafından da değerlendirildi ve yüzde doksandan fazla sanatçı “gizleme” yazılımını kendi çalışmalarında kullanmaya yöneldi.

Modelin, aynı sanatçıya ait gizlenmiş ve gizlenmemiş görüntülerin bir karışımı üzerinde eğitildiğinde de aynı şekilde başarısız taklitler ortaya koyması, gizlenmemiş çalışmaları mevcut üretici modellerini eğitmek için halihazırda kullanılmış olan sanatçılara da umut veriyor.

Araştırma konuyla ilgili “Protecting Artists from Style Mimicry by Text-to-Image Models” başlıklı bir makaleyi de meydana getirdi. SAND Lab şu anda yazılımı indirilebilir hale getirmek için çalışıyor.

Derleyen: Alp Eren Gümüş