- Yeni bir çalışmada sahte “remake” film yapımlarının deepfake ile üretilmiş kliplerinin, katılımcıların yarısının filmleri yanlış bir şekilde hatırlamasına neden olduğu keşfedildi.

- Bu sahte filmlerin basit metin açıklamalarının benzer oranlarda yanlış hafıza ürünü ürettiği de tespit edildi.

- Çalışma; University College Cork, İrlanda’dan Gillian Murphy ve Science Foundation Ireland Yazılım Araştırma Merkezi Lero tarafından yürütüldü.

Deepfake videolar, yapay zeka (AI) teknolojisi kullanılarak oluşturulan manipüle edilmiş veya değiştirilmiş videolar olarak bilinir. Bu videolar, mevcut bir videodaki bir kişinin yüzünün veya sesinin başka bir kişiyle değiştirilmesini içerir ve genellikle son derece gerçekçi, inandırıcı görsel ve işitsel efektlerle sonuçlanır.

Deepfake teknolojisinin potansiyel riskleri ile faydalarını incelemek için Murphy ve ekibi, 436 katılımcıyı çevrim içi bir anketi doldurmaya davet etti.

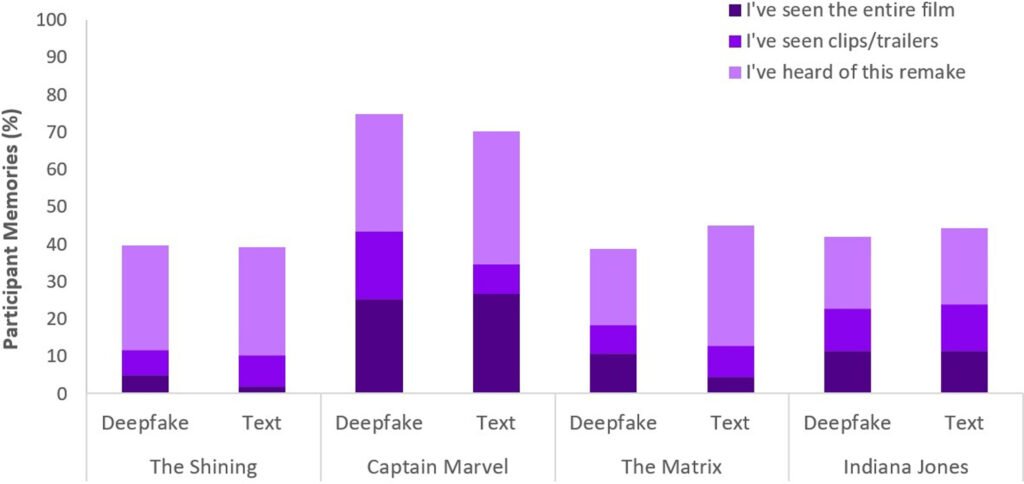

Anket, “The Matrix”te Keanu Reeves’in yerine Neo olarak Will Smith’in ve “The Shining”de Brad Pitt ile Angelina Jolie’nin yer alması gibi farklı aktörlerin yer aldığı kurgusal remake film yapımlarının deepfake videolarını izlemeyi içeriyordu.

“Charlie & The Chocolate Factory” ve “Total Recall” gibi gerçek uyarlamalar da karşılaştırma içine dahil edildi. Bazı durumlarda katılımcılar, deepfake videolarını izlemek yerine remake yapımların metin açıklamalarını okudular. Katılımcılara, anketin ilerleyen zamanlarına kadar bu yapımların deepfake ile üretildiği bilgisi verilmedi.

Daha önceki araştırmalarda gözlemlendiği gibi hem deepfake videolar hem de yazılı açıklamalar, katılımcıların sahte remake yapımlarına dair yanlış anılar geliştirmesine neden oldu ve katılımcıların ortalama yüzde 49’unun her biri, izlediği uydurma filmin orijinal bir film olarak var olduğuna inanıyor.

İlginç bir şekilde bazı katılımcılar, sahte remake yapımlarla ilgili anılarını bile dile getirdiler.

Bununla birlikte, metin açıklamalarından elde edilen yanlış bellek oranları da benzerdi; bu, deepfake teknolojisinin diğer yöntemlere veya araçlara kıyasla belleği manipüle etme konusunda özel bir yeteneğe sahip olmayabileceğini gösteriyor.

Çalışma ayrıca çoğu katılımcının, filmleri yeniden canlandırmak için deepfake teknolojisini kullanma fikrinden rahatsızlık duyduğunu ortaya koydu. Sanatsal bütünlüğe potansiyel saygısızlık ve filmlerle ilgili paylaşılan sosyal deneyimlerin kesintiye uğraması konusunda endişeler dile getirildi.

Bu bulguların, film endüstrisinde deepfake teknolojisinin geliştirilmesi ve düzenlenmesi için çıkarımları var. Araştırmacılar, deepfake’in rıza dışı pornografi ve zorbalık gibi çeşitli nedenlerle endişe uyandırabileceğini düşünmelerine rağmen bu çalışmanın, diğer teknik olmayan araçlara kıyasla anıları çarpıtma konusunda doğası gereği daha güçlü olmadığını gösterdiğini vurguladılar.

Deepfake teknolojisi, hedef kişinin yüz ifadeleri ile konuşma modellerini analiz etmek ve kaynak videoya eklemek için makine öğrenimi algoritmalarını ve derin sinir ağlarını kullanır. Bu süreç, orijinal görünen ancak sahte içerik içeren videoların oluşturulmasına olanak tanır.

Bu videolar, potansiyel olarak kötüye kullanımları ve ortaya çıkan etik kaygıları nedeniyle korku uyandırdı. Bu teknoloji; yanlış bilgi yayma, kamuoyunu manipüle etme ve bireylerin itibarına ve mahremiyetine zarar verme potansiyeline ilişkin endişeleri artırıyor.

Derleyen: Ceren Korkmaz