- OpenAI’ın görüntü oluşturucusu DALL-E 3, daha fazla şirketin Coalition for Content Provenance and Authenticity (C2PA) standartlarını desteklemeye başlamasıyla birlikte görüntü meta verilerine filigran ekleyecek.

- Şirket, C2PA filigranlarının ChatGPT web sitesinde ve DALL-E 3 modeli için API’de oluşturulan görüntülerde görüneceğini söylüyor.

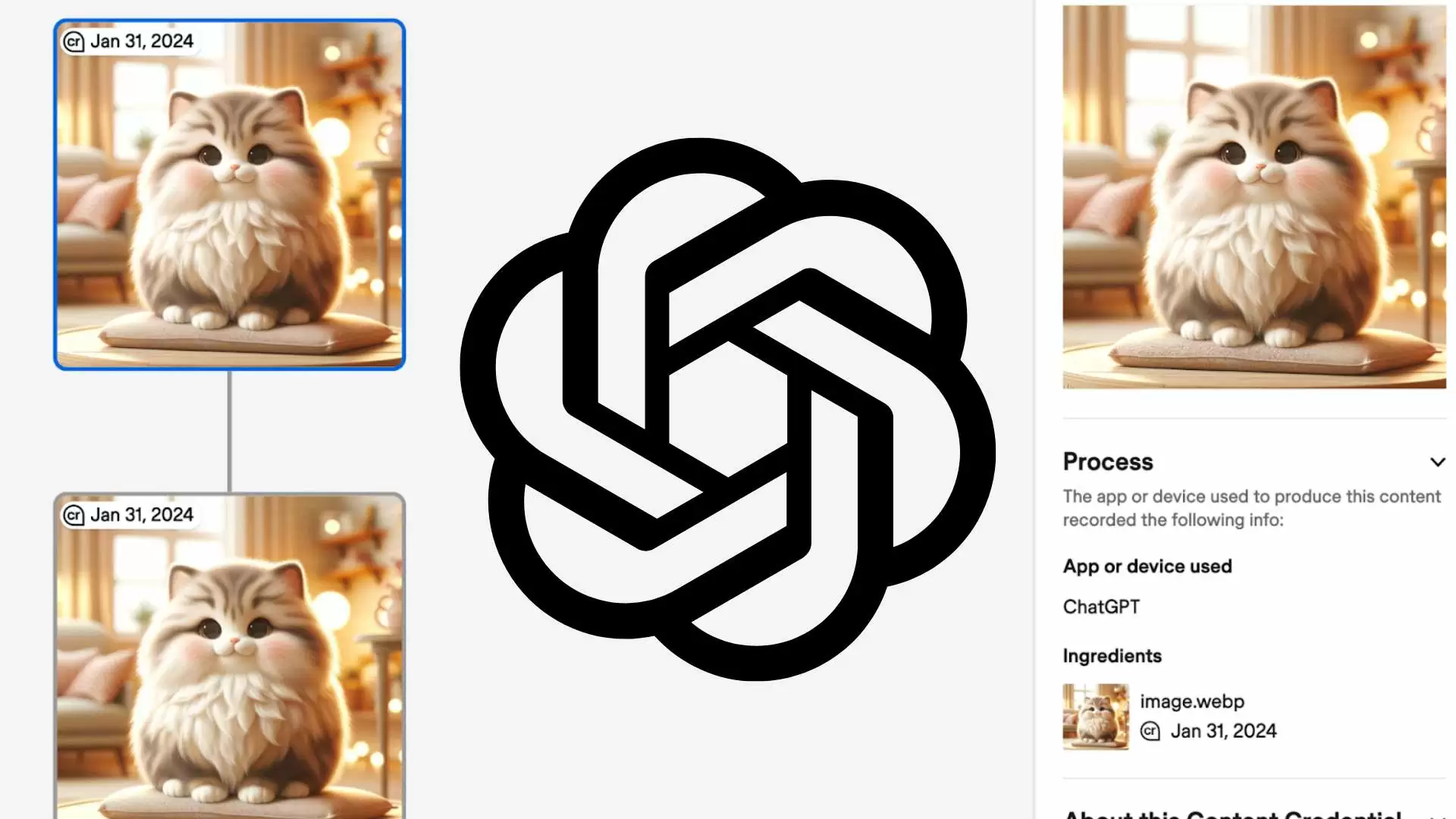

- Filigranlar hem görünmez bir meta veri bileşeni hem de her görüntünün sol üst köşesinde görünecek olan görünür bir CR sembolü içerecek.

OpenAI’ın görüntü oluşturucusu DALL-E 3, daha fazla şirketin Coalition for Content Provenance and Authenticity (C2PA) standartlarını desteklemeye başlamasıyla birlikte görüntü meta verilerine filigran ekleyecek.

Şirket, C2PA filigranlarının ChatGPT web sitesinde ve DALL-E 3 modeli için API’de oluşturulan görüntülerde görüneceğini söylüyor. Mobil kullanıcılar filigranları en geç 12 Şubat’ta alacak. Bunlar hem görünmez bir meta veri bileşeni hem de her görüntünün sol üst köşesinde görünecek olan görünür bir CR sembolü içerecek.

İnsanlar, Content Credentials Verify gibi web siteleri aracılığıyla OpenAI platformları tarafından üretilen herhangi bir görüntünün kaynağını (içeriği oluşturmak için hangi AI aracının kullanıldığını) kontrol edebilir. Şimdiye kadar, video veya metin değil yalnızca hareketsiz görüntüler filigran taşıyabiliyordu.

OpenAI, filigran meta verilerinin görüntülere eklenmesinin “gecikme üzerinde ihmal edilebilir bir etkiye sahip olduğunu ve görüntü oluşturma kalitesini etkilemeyeceğini” söylüyor. Ayrıca bazı görevler için görüntü boyutlarını biraz artıracağı ekleniyor.

Adobe ve Microsoft gibi şirketlerden oluşan bir grup olan C2PA, içeriğin kaynağını belirlemek ve insanlar tarafından mı yoksa yapay zeka ile mi yapıldığını göstermek için Content Credentials filigranının kullanılması için baskı yapıyor. Adobe, OpenAI’ın DALL-E 3 kreasyonlarına eklediği bir Content Credentials sembolü oluşturdu. Meta kısa süre önce sosyal medya platformlarında yapay zeka tarafından oluşturulan içeriğe etiketler ekleyeceğini duyurdu.

Yapay zeka tarafından üretilen içeriğin tanımlanması, Biden yönetiminin yapay zekaya ilişkin idari emrindeki en önemli direktiflerden biri. Ancak filigranlama yanlış bilgilendirmeyi durdurmanın kesin bir yolu değil. OpenAI, C2PA’nın meta verilerinin “yanlışlıkla ya da kasıtlı olarak kolayca kaldırılabileceğine” dikkat çekiyor, özellikle de çoğu sosyal medya platformu yüklenen içerikten meta verileri genellikle kaldırdığı için. Bir ekran görüntüsü almak meta verileri atlar.

OpenAI kendi sitesinde, “Kaynağın belirlenmesine yönelik bu yöntemleri benimsemenin ve kullanıcıları bu sinyalleri tanımaya teşvik etmenin dijital bilginin güvenilirliğini artırmanın anahtarı olduğuna inanıyoruz” diyor.

Derleyen: Alp Eren Gümüş

![]()