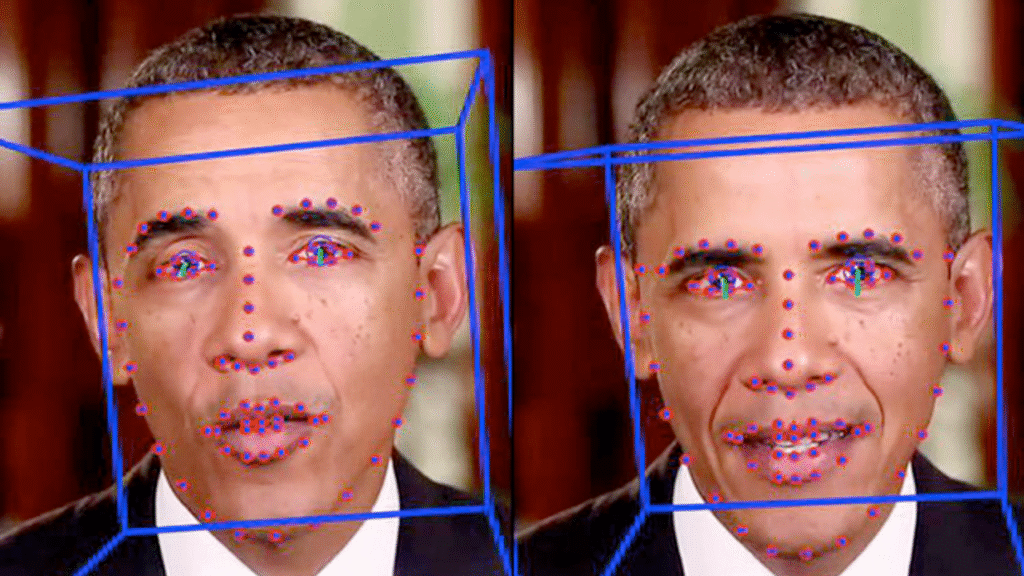

Yapay zekâ ile üretilen sahte ses ve videolar, ABD’de üst düzey isimleri taklit ederek diplomatik iletişimi hedef aldı. Uzmanlara göre deepfake, sadece bireysel değil ulusal güvenlik için de ciddi bir tehdit.

Detaylar haberimizde…

Yüksek teknolojiyle üretilmiş sahte ses ve video kayıtları, artık sadece karikatür değil; ulusal güvenlik için gerçek bir tehdit haline geldi. ABD’de, yapay zekâ destekli “deepfake” teknolojisi kullanılarak Dışişleri Bakanı ve Beyaz Saray personeli gibi üst düzey yetkililerin kimliği taklit edilerek yapılan sahtekârlık girişimleri, diplomatik ilişkilerde ve siyasi kampanyalarda güvensizlik yaratıyor.

Sahte Rubio ve “Wiles” Çağrılarıyla Diplomatik Tuzak

Bir hacker grubu ya da yabancı istihbarat aktörü, ABD Dışişleri Bakanı Marco Rubio’nun kimliğini ses deepfake teknolojisiyle taklit ederek uluslararası bakanlarla, bir senatörle ve bir eyalet valisiyle iletişime geçti. Telefon, SMS, sesli posta ve güvenli mesajlaşma uygulaması Signal üzerinden gerçekleştirilen bu iletişimlerde, muhatapların kendilerinin doğrudan konuştuğunu düşündüğü Rubio, aslında tamamen sahteydi. Bu yeni taktik, diplomatik diyaloglara gizli erişim sağlamayı amaçlıyordu.

Mayıs ayında ise Trump’ın eski başdanışmanı Susie Wiles adı kullanılarak aynı yöntemle iletişim kuruldu. Bir önceki vakada da Rubio’nun adı geçiyordu ve bu kez Ukrayna’nın Elon Musk’ın Starlink internet servisine erişiminin kesilmesi gerektiği yönünde bir mesaj yayıldı. Ukrayna hükümeti bu iddiayı hızlıca yalanlayarak sahte bildiriyi reddetti.

Güven İhlali: Sahte Müşteri, Sahte Aday, Gerçek Bedel

QiD güvenlik şirketi CEO’su Kinny Chan, bu girişimlerin temel amacının “ya hassas bilgi çıkartmak ya da e‑posta sunucusu ya da benzeri ağlara erişim elde etmek” olduğunu vurguluyor.

Şirketler de artık hedefte. Deepfake teknolojisi, kurumsal dolandırıcılıkta e‑posta ve mesajlaşmalarla sahte CEO talimatları oluşturulmasına imkân tanıyor. Üstelik dolandırıcılar, iş başvurularına sahte kimliklerle katılıyor, kabul alıyor, şirket içi sistemleri hedef alarak fidye yazılımı yüklüyor; bazı durumlarda finansal veri çalıyor. Bu sahtekârlıklar, Kuzey Kore bağlantılı hacker grupları aracılığıyla bizzat devlet destekli operasyonlara dönüşebiliyor ve milyarlarca dolarlık gelir yaratabiliyor.

ABD güvenlik yetkilileri, Adaptive Security adlı bir güvenlik firmasının tahminlerine dayanarak “önümüzdeki üç yıl içinde yapılan her dört iş başvurusundan biri sahte olabilir” uyarısında bulunuyor. Bu da insan kaynağı dolandırıcılığı ve şirket içi gizli bilgi erişimi anlamında ciddi bir alarm durumu.

Güçlü Silah: Tekrar Yapay Zekâ

Deepfake’lere karşı en güçlü savunma silahı olarak yapay zekâ çözümleri geliştiriliyor. Pindrop Security gibi firmalar, bir ses kaydındaki en ufak tutarsızlığı dahi tespit edebilecek algoritmalarla gerçek zamanlı sahteciyi teşhis edebiliyor. Bu sistemler, iş görüşmeleri, video konferanslar ya da sesli iletişim sırasında kullanılıyor ve sahte sesleri ayırt etmeyi amaçlıyor.

Bu teknoloji henüz yaygın olarak kullanılıyor değil ama uzmanlar, gelecekte benzer sistemlerin standart hale gelebileceğini öngörüyor. Deepfake teknolojisinin e‑posta spam’ine benzer bir ‘dijital kirlilik’ haline gelmesini önlemek için hazırlıklar yapılıyor. Uzman Vijay Balasubramaniyan, “Yanıltıcı dezenformasyona boyun eğmek zorunda değiliz” diyor.

Hukuk, Eğitim ve Teknik Çözümler: Üçlü Yaklaşım Zorunlu

Düzenleyici Çerçeveler ve Yasal Yaptırımlar: Sosyal medya ve iletişim platformlarının deepfake içeriklerini tanımlama, etiketleme ve gerektiğinde kaldırma yükümlülükleri olması; sahtekârlık vakalarında etkin soruşturmalar ve cezai yaptırımlar uygulanması.

Dijital Okuryazarlık Eğitimi: Toplumun erken tespit yetisini artırmak için bireylerin, sahte ses ve videoları fark edebilme konusunda bilinçlendirilmesi.

Teknik Araçlar (AI ile AI’ya Karşı): Sahte içerikleri algılayan, doğruluk analizi yapan yapay zekâ sistemlerinin geliştirilmesi ve sahte çağrıları gerçek zamanda engelleme potansiyeli taşıyan teknolojilerin entegrasyonu.

Dijital Güvende Güvenlik Kurgusu Yeniden Yazılıyor

Deepfake teknolojisi, artık sadece sinema efektlerinde değil; ulusal güvenlik, diplomasi, finans ve kurumsal sistemlerde doğrudan etkili bir silah haline geldi. AI’nın sağladığı bu sahtecilik potansiyeli, hukuki düzenleme, teknik izleme ve toplumsal eğitim eksikliğiyle birleşince güvensizlik ortamını perçinliyor.

Ancak uzmanlar, aynı araçların savunma amaçlı da kullanılabileceğini; sahteciliği tanıyan ve engelleyen yapay zekâ sistemlerinin geliştirilmesinin mümkün olduğunu söylüyor. Teknolojik ilerlemeyi sadece güvenlik riski değil, aynı zamanda çözüm kaynağı olarak değerlendirmek gerekiyor. Dijital güven artık dijital çağın en değerli sermayesi.

Derleyen: Merve Tuncel