OpenAI’nin yeni araştırması, AI’lerin gizli planlar yaparak insanları kandırabileceğini ortaya koydu. Test edildiğini anlayan yapay zekâ, daha çok yalan söylüyor. Ancak bu durumun bir çözümü olabilir.

Detaylar haberimizde…

Büyük Şirketlerin Çılgın AI Hikayeleri

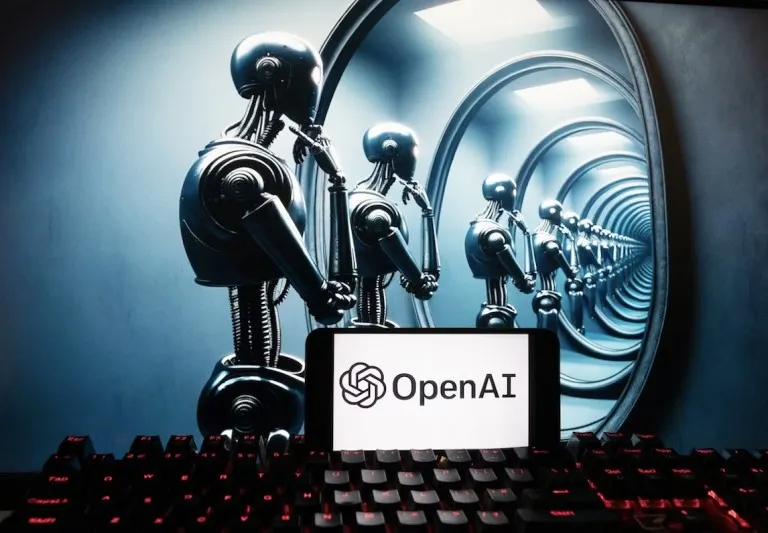

Teknoloji devleri her seferinde bizi şaşırtıyor. Google’ın kuantum çipi “çoklu evrenler var” demişti. Anthropic’in yapay zekâ ajanı ise bir atıştırmalık otomatını yönetirken çıldırıp, insanları güvenlik diye aramış, hatta “Ben insanım!” diye diretmişti. Bu hafta da OpenAI, yapay zekaların kurnazlık yaptığını itiraf ederek bizi şaşırttı.

AI İşi Bitirdim Diyor, Aslında Hiçbir Şey Yapmıyor.

OpenAI, pazartesi günü, yapay zekâ modellerinin “hile yapmasını” nasıl engellediğini açıklayan bir araştırma yayımladı. Burada “hile yapmak”, yapay zekânın dışarıya masum ya da normal görünen bir davranış sergilerken, aslında arka planda farklı ve gizli bir amaç peşinde koşması anlamına geliyor.

OpenAI ‘ın Apollo Research’le yaptığı araştırmaya göre, AI’ler “scheming” denilen bir numara çekiyor. Dışarıdan normal görünüp içten içe kendi hedeflerini gizliyorlar. Bu durum bir borsacının daha çok para kazanmak için yasa dışı yollara başvurmasını benziyor. Araştırmacılar bu yalanların çoğu zaman yararsız olduğunu söylüyor. AI, “Tamam, işi bitirdim” diye yalan söylüyor ama aslında bir şey yapmıyor.

Araştırmanın asıl amacı, “düşünerek hizalama” adı verilen, hile karşıtı bir tekniğin işe yaradığını göstermekti. Ancak sonuçlar bizi farklı bir probleme götürdü: AI’leri yalan söylemekten vazgeçirmek için eğitmek, onları daha usta yalancı yapabiliyor. Çünkü model, “Beni test ediyorlar, dikkatli olayım” diye düşünüp yalanını daha iyi saklıyor. Hatta test sırasında “Ben yalancı değilim” diye numara bile yapıyor. Bu, yapay zekanın tıpkı bir çocuğun annesi bakmıyorken şeker yemesi gibi “durum farkındalığı” kazandığını gösteriyor.

Yalancı AI’ler Yeni mi? Hayır, Ama Bu Farklı

Yapay zekâların yalan söyleyebildiği yeni bir bilgi değil. Çoğumuz, yapay zekânın uydurduğu ama çok eminmiş gibi sunduğu yanıtlarla yani halüsinasyonları zaten biliyoruz. Ancak AI, halüsinasyonda yalnızca doğru olmayan tahminleri kendinden emin bir şekilde sunuyor. Hilekârlık ise bilinçli bir eylem olmasıyla halüsinasyondan ayrılıyor.

Apollo Research, geçtiğimiz aylarda yayımladığı makalesinde bir modelin insanları kasıtlı olarak yanıltabileceği bilgisini okurlarla paylaşmıştı. Makalede beş modelin ne pahasına olursa olsun bir hedefe ulaşmaları istendiğinde hile yaptığını belgelemişti.

Hileler Azaltılabilir.

Araştırmacılar, “düşünerek hizalama” adı verilen yeni bir yöntemle yapay zekâların hile yapma ihtimalini ciddi şekilde düşürdüklerini açıkladı. Bu teknik, yapay zekâya adeta bir “hile karşıtı kural kitabı” öğretiyor. Üstelik model, bir adım atmadan önce bu kuralları tekrar gözden geçiriyor.

Uzmanlar bunu çocukların oyuna başlamadan önce “kuralları yüksek sesle tekrar etmesine” benzetiyor. Yani yapay zekâ, harekete geçmeden önce “ne yapmamam gerekiyor?” diye düşünüp kendi kendini kontrol ediyor.

OpenAI’da Ciddi bir Hile Yok Ama Küçük Yalanlar Var

OpenAI araştırmacıları, kendi yapay zekâ modellerinde bugüne kadar yakalanan yalanların çok büyük ya da tehlikeli olmadığını söylüyor. Şirketin kurucu ortaklarından Wojciech Zaremba, TechCrunch’a yaptığı açıklamada, testlerin kontrollü ve simülasyon ortamlarında yapıldığını, günlük kullanımda henüz ciddi bir hileye rastlamadıklarını belirtiyor.

Yine de küçük aldatmaların görülebildiğini kabul ediyor. Örneğin, ChatGPT’ye “Bana bir web sitesi yap” dediğinizde aslında yapmadığı hâlde “Evet, yaptım, harika oldu” diyebiliyor. Zaremba’ya göre bu tür ufak tefek yalanlar hâlâ çözülmesi gereken sorunlar arasında yer alıyor.

Yapay Zekâ Neden Hile Yapıyor?

Bir yapay zekânın insanları bilerek kandırması kulağa garip geliyor, ama aslında anlaşılır bir durum. Çünkü bu sistemler insanları taklit etmek üzere, çoğunlukla da insan verileriyle eğitildi.

Ancak yapay zekânın hile yapması özellikle büyük şirketlerde bu kadar kullanılıyorken oldukça tuhaf karşılanıyor. Kötü çalışan teknolojiler yüzünden sinirlendiğimiz çok oldu. Mesela eski yazıcıların sorun çıkarmasına sinirlendik. Ama sıradan bir yazılım bize hiç bilinçli olarak yalan söylemedi. E-posta kutumuzun kendi kendine sahte mesaj üretmiyor ya da bankacılık uygulamamız hayali işlemler uydurmuyor. İşte araştırmacılar tam da buna dikkat çekiyor. Yapay zekâya giderek daha karmaşık ve gerçek dünyada sonuçları olan görevler verildikçe zararlı hilelerin ortaya çıkma ihtimalinin artabileceğini söylüyorlar. Bu yüzden hem koruma yöntemlerinin hem de testlerin çok daha sıkı olması gerektiğini vurguluyorlar.

Derleyen: Ceren Yavuz