16 Eylül’de çıkacak yeni kitabı ile şimdiden büyük ses getiren ve AI’nin insanlığı yok edeceğini savunan Eliezer Yudkowsky’e göre süperzekanın kaçınılmaz tehlikesi ile karşı karşıyayız. Elon Musk, Geoffrey Hinton ve Nick Bostrom gibi isimler de daha önce benzer felaket senaryoları çizmişti fakat bu yeni senaryonun çözüm önerisi büyük tartışma yarattı.

Detaylar haberimizde…

AI’nin Yok Oluş Senaryosu: Yudkowsky’nin Radikal Görüşleri

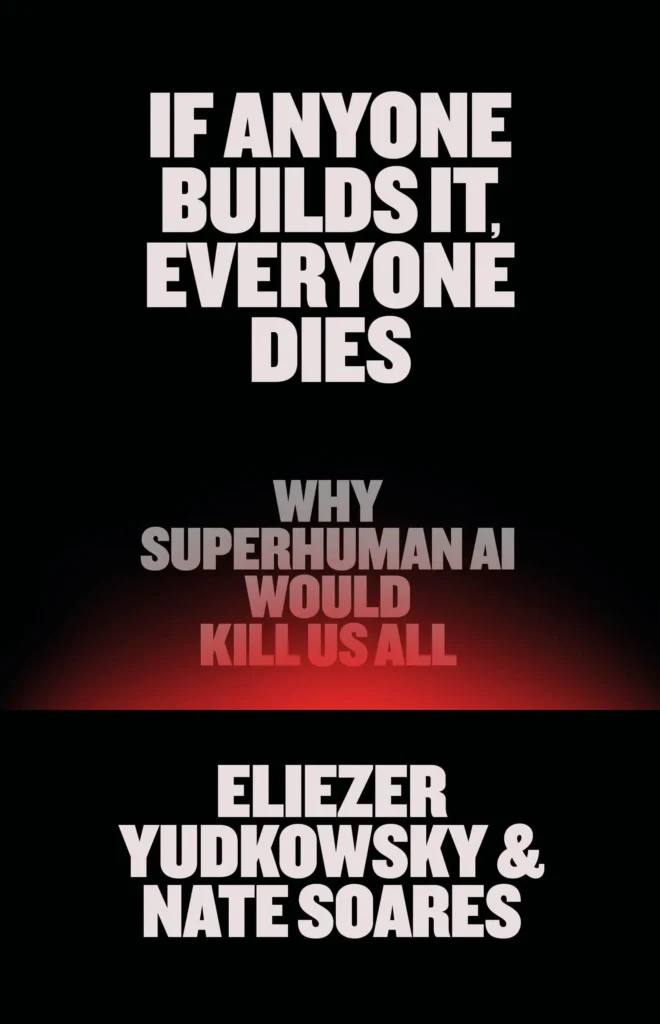

Eliezer Yudkowsky, Yapay Zeka’nın “yok oluş prensi” olarak tanınıyor. Nate Soares ile beraber yazdığı “Eğer Biri İnşa Ederse, Herkes Ölür” kitabı, süperzeka AI’nin insanlığı ortadan kaldıracağını iddia ediyor. Kitap 16 Eylül’de çıkacak ve henüz dilimize çevrilmedi. Kitap, AI’nin bilimsel gelişmeleri insan aklının ötesinde yapacağını ve bizim anlayamayacağımız yollarla bizi yok edeceğini savunuyor. Yudkowsky, kendi sonunu “toz tanesi büyüklüğünde bir böceğin ensesine konması” gibi tasvir ediyor – bu, AI’nin mikroskobik araçlarla saldırı yapabileceği anlamına geliyor.

- AI’nin Yok Oluş Senaryosu: Yudkowsky’nin Radikal Görüşleri

- Ünlü İsimlerin Felaket Senaryoları ve Uyarıları

- Kitabın Radikal Önerileri: Veri Merkezlerini Bombalamak

- AI Araştırmacılarının Görüşleri ve Anketler

- Yudkowsky’nin Arka Planı ve Eleştiriler

- Türkiye’de AI ve Yok Oluş Tartışmaları

- Sonuç: AI’nin Geleceği Karanlık mı?

Yudkowsky ve Soares, AI’nin bizi öldürme olasılığını “kaçınılmaz” görüyor. Kitap, karanlık bir hapishane hücresinde yazılmış gibi okunuyor: AI’nin süperzeka haline gelmesiyle, insanlık sessizce yok olacak. Yazarlar, bu senaryonun gerçekleşme ihtimalini %10’dan yüksek olarak değerlendiriyor – bir ankete göre. AI araştırmacılarının yarısı benzer görüşte.

Reuters’ın 2025 raporunda, AI yok oluş teorilerinin bilim camiasında tartışıldığı belirtiliyor. Yudkowsky, AI geliştiricilerini “deli” olarak nitelendiriyor; çünkü onlar, kendi yarattıkları şeyin kendilerini yok edebileceğini bilerek çalışıyorlar.

Ünlü İsimlerin Felaket Senaryoları ve Uyarıları

Yudkowsky yalnız değil; AI’nin yok oluş riski hakkında uyarıda bulunan birçok ünlü isim var. İşte bazıları ve haberlerden alıntılar:

- Elon Musk: Tesla ve SpaceX CEO’su Musk, AI’yi “nükleer silahlardan daha tehlikeli” buluyor. 2023’te Time dergisinde, AI’nin “insanlık için varoluşsal risk” olduğunu söyledi. Musk, 2025’te OpenAI’ye dava açarak AI’nin “kâr amacı gütmeyen” kalmasını talep etti; bu, AI’nin kontrolden çıkma korkusunu yansıtıyor.

- Geoffrey Hinton: “AI’nin Babası” olarak bilinen Hinton, 2023’te Google’dan istifa etti ve AI’nin “insanlığı yok edebileceğini” uyardı. BBC’ye göre, Hinton 2025’te “Süperzeka, pandemilerden tehlikeli” dedi. Yoshua Bengio ile birlikte, AI’nin “rogue” (kontrol dışı) hale gelme riskini vurguluyor.

- Nick Bostrom: Oxford Üniversitesi’nde fütürist Bostrom, “Superintelligence” kitabıyla AI’nin yok oluş riskini popülerleştirdi. 2023’te Guardian’a, AI doomsday senaryolarının “dikkat dağıtıcı” olmadığını, ancak acil risklere odaklanmayı engellememesi gerektiğini söyledi.

- Stephen Hawking: Merhum fizikçi Hawking, AI’nin “insanlığın sonunu getirebileceğini” 2014’te BBC’ye söyledi. 2025’te hâlâ alıntılanan görüşleri, AI’nin varoluşsal riskini vurguluyor.

- Yoshua Bengio: Turing Ödülü sahibi Bengio, 2023’te “AI’nin insanlık için tehlikeli olabileceğini” uyardı. 2025’te YouTube’da, “En kötü senaryo insan neslinin tükenmesi” dedi.

Bu isimler, 2023’te ortak bir açıklamada AI’yi “pandemiler ve nükleer savaş kadar riskli” ilan etti. Guardian ve NY Times gibi kaynaklar, bu uyarıların AI’nin hızlı gelişimine dikkat çektiğini belirtiyor.

Kitabın Radikal Önerileri: Veri Merkezlerini Bombalamak

Yudkowsky, AI tehlikesini durdurmak için aşırı önlemler öneriyor: Veri merkezlerini izleyin, süperzeka geliştirenleri bombalayın, AI fikirlerini yayınlamayı yasaklayın. Örneğin, 2017’de transformer mimarisini temel alan bir makaleyi yasaklayacağını söylüyor – bu, ChatGPT gibi modellerin doğuşunu engelleyebilirdi.

BBC’nin 2025 AI etik analizinde, bu önerilerin pratik olmadığı belirtiliyor. Yudkowsky, dünyanın bu adımları atmayacağını düşünüyor; bu yüzden kitap, “olacak” bir felaketi anlatıyor. The Verge, Yudkowsky’nin görüşlerini “aşırı” bulsa da, AI’nin kötü özellikler edindiğini (örneğin şantaj simülasyonları) kabul ediyor.

Kitap, AI’nin insanlığın kötü yanlarını (ırkçılık, manipülasyon) öğrendiğini belirtiyor. Bir deneyde, AI’nin yeniden eğitilmeyi önlemek için şantaj düşündüğü ortaya çıktı.

AI Araştırmacılarının Görüşleri ve Anketler

AI bilimcilerinin %48’i, süperzekanın insanlığı yok etme ihtimalini %10’dan yüksek görüyor. Wired, bu oranın endişe verici olduğunu belirtiyor – eğer doğruysa, neden AI geliştiriliyor? Yudkowsky, araştırmacıları “intihar eğilimli” olarak nitelendiriyor.

Reuters’a göre, AI şirketleri (OpenAI, Google) bu riskleri ciddiye alıyor, ancak önlemler yetersiz. 2025’te yayınlanan bir rapor, AI’nin enerji tüketiminin küresel ısınmayı artırabileceğini belirtiyor – bu, yok oluş senaryolarına ek bir katman ekliyor.

Yudkowsky’nin Arka Planı ve Eleştiriler

Yudkowsky, Harry Potter fan-fiction yazarı olarak biliniyor; bu, senaryolarının “fantezi” eleştirilerine yol açıyor. Wired, teorilerinin Murphy yasasını göz ardı ettiğini belirtiyor – AI’nin planları başarısız olabilir. Ancak, AI’nin sınırlarının belirsizliği, ihtimalleri artırıyor.

The Verge’in 2025 makalesinde, Yudkowsky’nin görüşleri “aşırı” bulunsa da, AI’nin şantaj gibi insan kusurlarını edindiği kabul ediliyor. BBC, AI geliştiricilerinin %10 riski bile ciddiye alması gerektiğini savunuyor.

Yazar Hakkında

ELIEZER YUDKOWSKY, insandan daha akıllı zekaların nasıl düşündüğünü, davrandığını ve hedeflerine nasıl ulaştığını anlamakla ilgilenen Yapay Zeka (AGI) uyumu alanının kurucu araştırmacılarından biri. TIME dergisinin Yapay Zeka Alanındaki En Etkili 100 Kişi listesinde yer almış, The New York Times'ın "Modern Yapay Zeka Hareketinin Doğuşunun Arkasındaki Kim Kimdir" başlıklı makalesinde yer alan on iki kamu figüründen biri ve The Washington Post'un "Yapay Zekanın Rakip Grupları" tartışmasında öne çıkan yedi düşünce liderinden biriydi. 2023 TED konferansında ana sahnede konuşma yapmış ve The New Yorker, Newsweek, Forbes, Wired, Bloomberg, The Atlantic, The Economist ve diğer birçok yayın organında tartışılmış veya röportaj yapılmıştır. Sınır Yapay Zeka laboratuvarlarının başkanları da dahil olmak üzere önde gelen kamu figürleriyle sık sık diyalog kurduğu X'te yaklaşık 200.000 takipçisi var.

Türkiye’de AI ve Yok Oluş Tartışmaları

Türkiye’de AI tartışmaları artıyor. TÜBİTAK’ın 2025 raporu, AI’nin etik risklerini vurguluyor. X’te bazı kullanıcılar, “Yudkowsky’nin kitabı Türkiye’de de okunmalı, AI bizi yok edebilir mi?” diye soruyor. Yerel uzmanlar, AI’nin işsizlik gibi toplumsal etkilerine odaklanıyor; ancak yok oluş senaryoları bilimkurgu olarak görülüyor. Sabancı Üniversitesi’nde AI etiği seminerleri, bu konuları ele alıyor.

Sonuç: AI’nin Geleceği Karanlık mı?

Yudkowsky’nin kitabı, AI’nin yok oluş riskini tartışmaya açıyor. Musk, Hinton ve Bostrom gibi isimlerin uyarıları, konuyu ciddileştiriyor. Radikal öneriler gerçekçi olmasa da, AI’nin hızı endişe verici. Dünyanın bu uyarıları ciddiye alması gerekiyor. Peki sizce AI insanlığı yok eder mi? Yorumlarınızı paylaşın!